Depuis (en 1941), les ordinateurs ont pris forme, ils ont d'abord rempli des pièces entières, puis des bureaux, puis des poches. Mais ils avaient tous une chose en commun: ils ont été conçus par des esprits humains. Au fil des ans, de nombreuses personnes se sont demandées: et si les ordinateurs se concevaient eux-mêmes?

Un jour prochain, un ordinateur intelligent pourrait lui-même créer une machine bien plus puissante que lui. Ce nouvel ordinateur en fabriquerait probablement un autre encore plus puissant, et ainsi de suite. L’intelligence artificielle parcourt une courbe ascendante exponentielle, atteignant des sommets de cognition inconcevables pour les humains. Telle est, en un mot, la singularité technologique.

Singularité technologique

Le terme « singularité technologique » remonte à plus de 50 ans, lorsque les scientifiques commençaient tout juste à bricoler le code binaire et les circuits qui rendaient possibles les calculs de base. Déjà à cette époque, la singularité technologique était un concept étonnant et formidable.

Une nouvelle génération d'ordinateurs super intelligents pourrait tout révolutionner. De la nanotechnologie à la réalité virtuelle immersive en passant par les voyages spatiaux superluminaux.

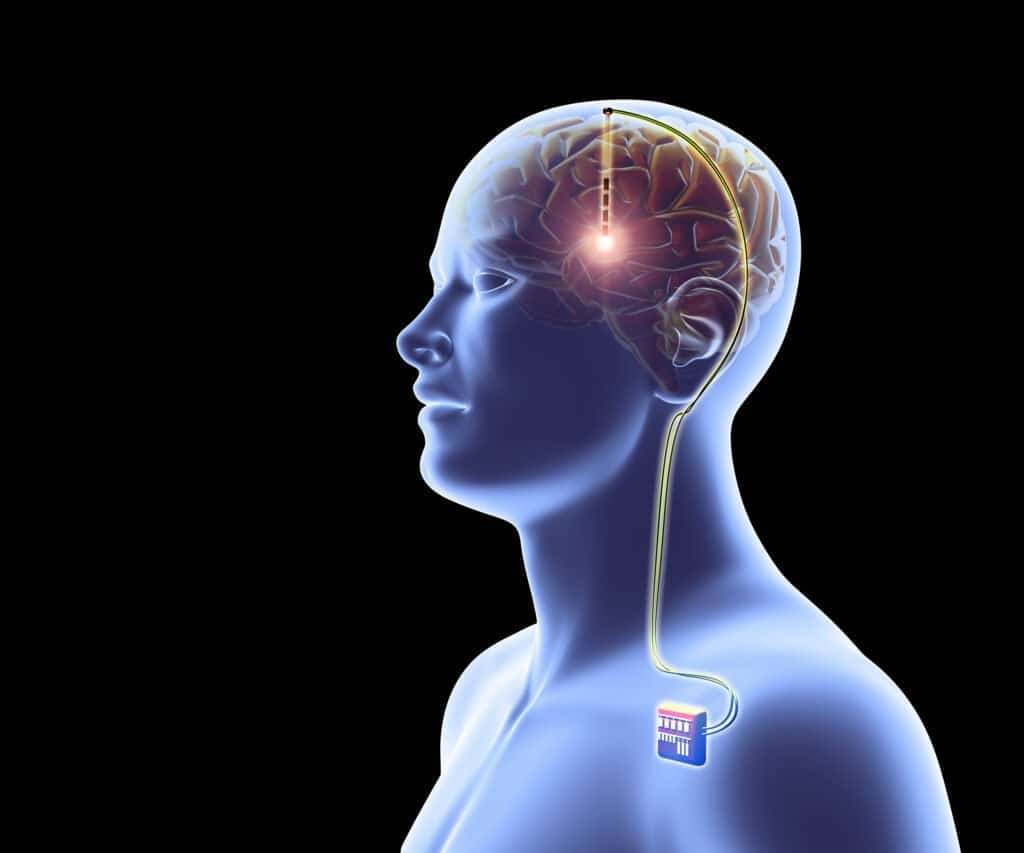

Grâce à la singularité technologique, au lieu de simplement exploiter notre cerveau biologique, nous pourrions utiliser l’intelligence artificielle pour s’interfacer avec lui. Améliorer ou augmenter les performances de notre cerveau avec des implants, ou même télécharger numériquement nos esprits pour survivre à nos corps.

Le résultat de la singularité technologique serait une humanité suralimentée, capable de penser à la vitesse de la lumière et libérée des préoccupations biologiques.

Un monde totalement nouveau

Le philosophe Nick Boström il pense que ce monde dynamique pourrait apporter une toute nouvelle ère.

Dans ce monde, nous serions tous plus comme des enfants dans un Disneyland géant dirigé non pas par des humains, mais par des machines que nous avons créées ou qu'ils ont créées eux-mêmes.

Nick Boström, philosophe, écrivain et directeur du Future of Humanity Institute de l'Université d'Oxford

Le ciel étoilé au-dessus de moi, la loi morale à l'intérieur de mon processeur

La singularité technologique pourrait nous entraîner dans un fantasme utopique ou dans un cauchemar dystopique. Et Bostrom le sait bien. Il réfléchit depuis des décennies à l’émergence de l’IA superintelligente et sait par cœur les risques que comportent de telles créations.

Il y a bien sûr le cauchemar classique de la science-fiction d’une révolution robotique, dans laquelle les machines décident qu’elles préfèrent contrôler la Terre.

Ce qui est encore plus probable, cependant, est la possibilité que le code moral d’une IA superintelligente, quel qu’il soit, ne corresponde tout simplement pas au nôtre.

Une IA responsable des flottes de voitures autonomes ou de la distribution de fournitures médicales pourrait faire des ravages si elle n’accordait plus la même valeur à la vie humaine que nous.

Le problème de l’alignement de l’IA, comme on l'appelle, a pris une nouvelle urgence ces dernières années, en partie grâce au travail de penseurs comme Bostrom.

Singularité technologique et différences de pensée

Si nous sommes incapables de contrôler une intelligence artificielle superintelligente, notre sort pourrait dépendre de la question de savoir si l’intelligence artificielle future pensera comme nous. Sur ce front, Bostrom nous rappelle que des efforts sont en cours pour « concevoir l'IA de manière à ce qu'elle choisisse réellement des choses qui sont bénéfiques pour les humains, et choisisse de nous demander des éclaircissements lorsque ce que nous voulons dire n'est pas clair. » "

Il existe des moyens d'enseigner la moralité humaine à une surintelligence naissante. Les algorithmes d'apprentissage automatique pourraient apprendre à reconnaître le système de valeurs humaines, comme aujourd'hui GAN ils sont formés sur une base de données d'images et de textes. Ou, plusieurs IA pourraient se disputer, sous la supervision d'un modérateur humain, pour construire de meilleurs modèles de préférences humaines.

Une question de respect

Si la singularité technologique devait créer non plus de simples machines, mais de véritables esprits pensants artificiels, il faudrait aussi considérer l’aspect éthique. Il deviendrait, dit Bostrom, une nécessité de se demander s’il est juste de les influencer, et dans quelle mesure.

En cette ère de machines conscientes, bref, la singularité technologique pourrait imposer une nouvelle obligation morale aux êtres humains: traiter les êtres numériques avec respect.