Secondo le dernier rapport des Nations Unies sur la guerre civile en Libye, l'année qui s'achève a vu pour la première fois un système d'armes autonome, un robot tueur, tuer quelqu'un. À l’avenir, nous pourrions nous en souvenir comme du point de départ d’une nouvelle course aux armements qui pourrait nous nuire très gravement.

Ces derniers jours (du 13 au 17 décembre) La Convention des Nations Unies sur certaines armes classiques réunis sur le sujet, comme cela se produit tous les cinq ans. Depuis 1983, cette assemblée a choisi de limiter certaines armes cruelles telles que les mines antipersonnel. Cette fois, il a évoqué une éventuelle interdiction de ces armes autonomes. Et il n'est pas parvenu à un consensus pour les limiter.

C'était peut-être une erreur catastrophique.

Les systèmes d’armes autonomes sont des robots tueurs. Tout au long de cet article, vous m'entendrez toujours les appeler ainsi : des robots tueurs. Parce que c'est ce que je suis. Des systèmes dotés d’armes capables de fonctionner seules. Des systèmes conçus pour la guerre, pour tuer des gens. Les gouvernements du monde entier investissent massivement dans cette tendance.

D'un autre côté, évidemment, les organisations humanitaires (dont l'une, Stop The Killer Robots, que vous trouvez ici) se consacrent à demander des règles et des interdictions sur le développement de ces armes. Et ils le font bien. Si nous ne limitons pas l’utilisation des armes autonomes, cela finira très mal. Les technologies disruptives dans ce domaine seront capables de déstabiliser toutes les stratégies militaires, augmentant ainsi le risque d’attaques préventives. Y compris chimiques, biologiques, nucléaires.

Compte tenu du rythme de développement des robots tueurs, la réunion de l'ONU qui vient de se terminer a peut-être été une des dernières occasions pour éviter une nouvelle course aux armements. Ou le dernier.

Il y a quatre dangers qui semblent évidents pour quiconque lorsqu'il s'agit de systèmes robotiques tueurs.

Premier problème des robots tueurs : identification.

les armes autonomes seront-elles TOUJOURS capables de faire la distinction entre un soldat hostile et un enfant avec une arme-jouet ? La différence entre une simple erreur humaine (qui est également possible) et le mauvais réglage d’un algorithme pourrait amener le problème à une ampleur incroyable. Un expert autonome en armement a appelé Paul Scharré utilise une métaphore : celle d'une mitrailleuse défectueuse qui continue de tirer même lorsque vous retirez le doigt de la détente. Et tirez jusqu'à épuisement des munitions, car ce n'est qu'une machine. Il ne sait pas qu'il fait une erreur.

Quoi qu’on en dise, l’intelligence artificielle n’a pas encore sa propre morale (et il ne l'aura probablement jamais, il ne pourra jamais l'apprendre).

Le problème n'est pas que ça même une IA a tort, par exemple lorsqu'il reconnaît l'asthme comme un facteur qui réduit le risque de pneumonie, ou lorsqu'il identifie des personnes de couleur comme un gorille. C'est juste que lorsqu'il fait une erreur, celui qui l'a créé ne sait pas pourquoi il a commis une erreur et ne sait pas comment la corriger. Pour cette raison, je crois qu’il est impossible que des robots tueurs puissent se développer selon un quelconque critère « moral ».

Deuxième problème avec les robots tueurs : la prolifération bas de gamme.

Les forces armées qui développent des armes autonomes supposent qu’elles seront capables de les contenir et de les contrôler. Avez-vous entendu une idée plus stupide que celle-ci ? S’il y a une chose que l’histoire de la technologie des armes nous enseigne, une seule chose, c’est que les armes se propagent. Dans ce cas aussi c'était très prévisible.

Ce qui s'est passé dans le passé avec le Kashinkov, un fusil d'assaut devenu si accessible qu'il finit entre les mains de n'importe qui, peut se répéter pour les robots tueurs. Les pressions du marché peuvent conduire à la création d’armes autonomes efficaces, bon marché et pratiquement impossibles à arrêter. Surtout : répandu. Aux mains des gouvernements, des fous, du crime organisé ou des groupes terroristes.

C'est peut-être déjà arrivé. le Kargu-2, fabriqué par un entrepreneur turc de la défense, est un croisement entre un drone et une bombe. Il dispose d’une intelligence artificielle pour trouver et suivre des cibles. C'est un robot tueur, qui a déjà agi de manière autonome sur le théâtre de la guerre civile libyenne pour attaquer des personnes.

Troisième problème des robots tueurs : la prolifération haut de gamme.

Si l’on réfléchit ensuite aux risques « haut de gamme », on arrive au Zenit. Les nations pourraient rivaliser pour développer des versions de plus en plus dévastatrices d’armes autonomes, y compris celles capables de monter des armes chimiques, biologiques, radiologiques et nucléaires . Les dangers moraux d’une mortalité croissante par arme à feu seraient amplifiés par une utilisation croissante des armes à feu.

Bien sûr, ces robots tueurs sont susceptibles de venir avec des robots coûteux contrôleurs éthiques conçu pour minimiser les dommages collatéraux, chassant le mythe de l’attaque « chirurgicale ». Du bon truc rien que pour l’opinion publique, en somme. La vérité est que les armes autonomes modifieront même l’analyse coûts-avantages la plus banale que vous faites avant de planifier une guerre. Ce seront des dés de risque mortel, à lancer avec moins de souci.

Les guerres asymétriques menées sur le terrain par des nations dépourvues de technologies concurrentes deviendront plus courantes. Une instabilité extrêmement généralisée.

Quatrième et dernier problème : les lois de la guerre

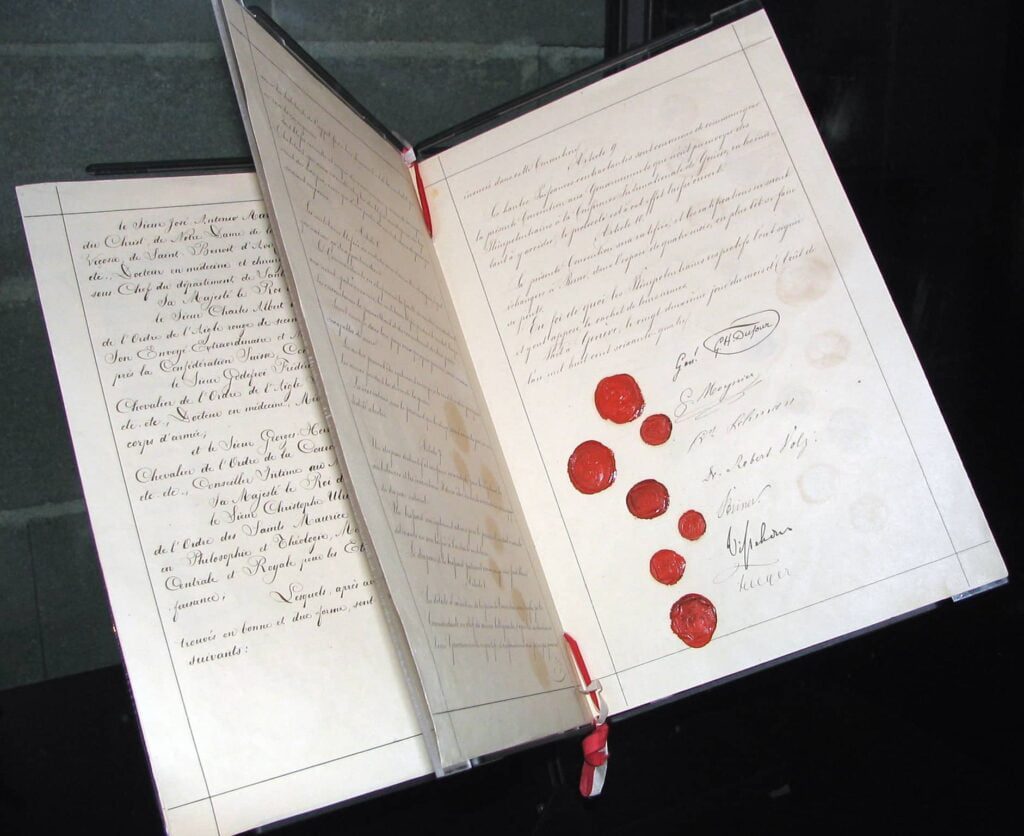

Les robots tueurs (s'ils prolifèrent, c'est une certitude) saperont le dernier palliatif de l'humanité contre les crimes de guerre et les atrocités : les lois internationales de la guerre. Ces lois, codifiées dans des traités dès le premier Convention de Ginevra, ils sont la fine ligne qui sépare la guerre de quelque chose d'encore pire que je peux à peine imaginer.

Les lois de la guerre sont fondamentales, car elles imposent également des responsabilités à ceux qui mènent une guerre. Slobodan Milosevic était le président d'un pays et devait répondre de ses actes. Il a été jugé par le Tribunal pénal international des Nations Unies pour l'ex-Yougoslavie et il devait répondre de ce qu'il avait fait.

Et maintenant? La faute est-elle à un robot tueur qui commet des crimes de guerre ? Qui est poursuivi ? L'arme? Le soldat? Les commandants des soldats ? L'entreprise qui a fabriqué l'arme ? Les ONG et les experts en droit international craignent que les armes autonomes ne conduisent à de graves conséquences. écart de responsabilité .

Il faudra prouver qu’un militaire a commis un crime en utilisant une arme autonome. Pour ce faire, il faudra prouver que le militaire a commis un acte coupable et qu’il avait également l’intention précise de le faire. Une dynamique assez compliquée, dans un monde de robots tueurs.

Un monde de robots tueurs est un monde sans règles qu'ils imposent contrôle humain important sur les armes. C'est un monde où des crimes de guerre seront commis sans qu'aucun criminel de guerre ne soit tenu responsable. La structure des lois de la guerre, ainsi que leur valeur dissuasive, s'en trouveront considérablement affaiblies.

Une nouvelle course mondiale aux armements

Imaginez que chacun puisse utiliser toute la force qu'il veut, quand il le veut. Avec moins de conséquences pour quiconque. Imaginez une planète où les militaires nationaux et internationaux, les groupes d'insurgés et les terroristes peuvent déployer une force meurtrière théoriquement illimitée avec un risque théoriquement nul aux moments et aux endroits de leur choix, sans aucune responsabilité légale qui en résulte.