En novembre dernier, Meta a annoncé qui aurait supprimé sa technologie de marquage par reconnaissance faciale. Aujourd'hui même Microsoft est sur le même plan, visant à rassurer les clients. Il va progressivement retirer son IA de reconnaissance faciale capable de détecter les émotions (et plus encore).

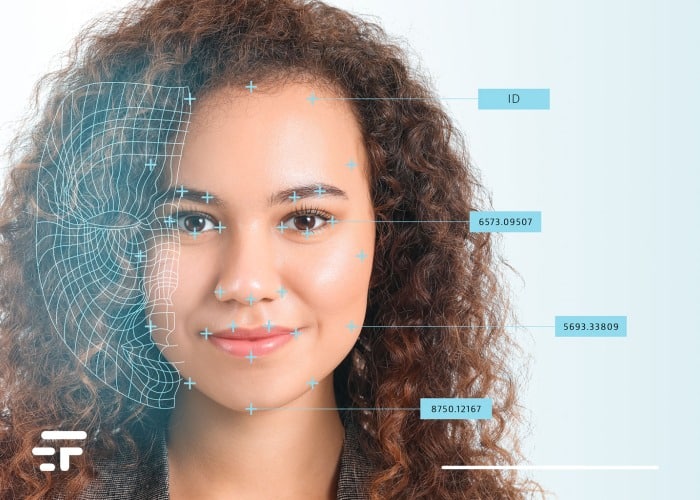

Selon le portail Engadget cette technologie ne peut tout simplement pas dire si vous êtes triste, heureux ou en colère. Avec sa capacité à identifier parfaitement des caractéristiques telles que l'âge, le sexe et les cheveux, le logiciel d'intelligence artificielle du géant de Redmond a soulevé d'inévitables (et légitimes) controverses sur la vie privée.

Le long au revoir

Dans un poster sur le blog de Microsoft, j'ai lu que les nouveaux utilisateurs du cadre de programmation Visage Microsoft ils ne pourront plus accéder à ses fonctionnalités. Qu’en est-il des clients existants ? Sereinement : ils pourront s'appuyer « uniquement » sur la technologie fin du 30 juin 2023.

Cette décision fait partie du plan de Microsoft visant à développer et à diffuser la technologie de l'intelligence artificielle. Une nouvelle stratégie « plus éthique » qui donnera accès aux logiciels de reconnaissance faciale uniquement via les plateformes propriétaires Azure Face API, Computer Vision et Video Indexer.

Nous supprimerons les fonctionnalités d'analyse faciale qui prétendent déterminer les émotions et les traits d'identité tels que le sexe, l'âge, le sourire, la pilosité faciale, la coiffure et le maquillage.

À partir de la version Microsoft

Tu les appelles si tu veux des émotions

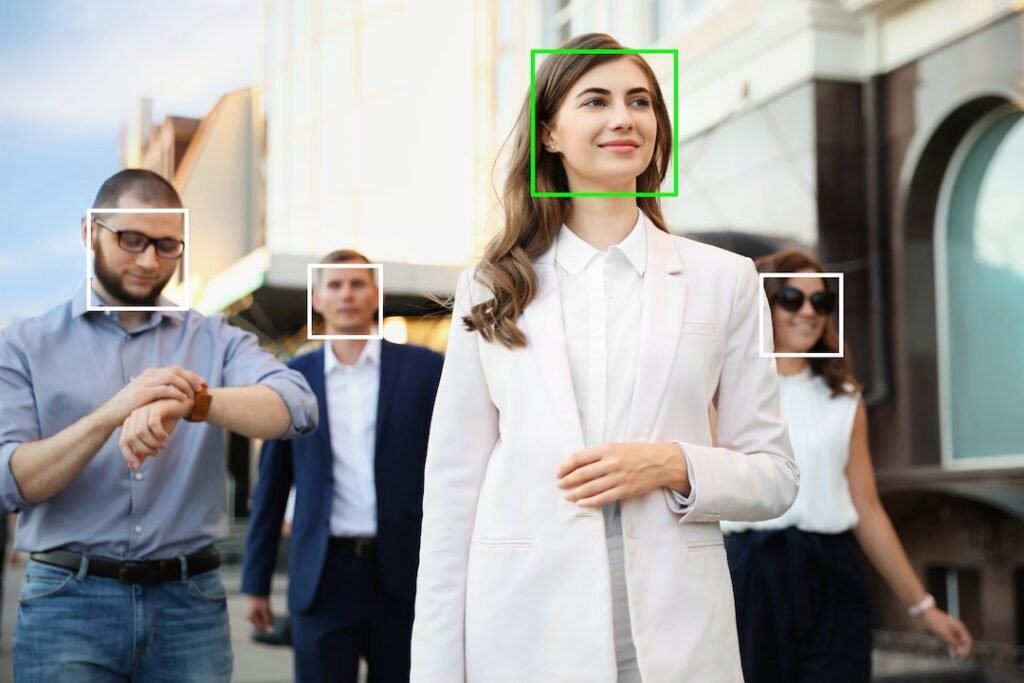

Inutile de le dire, vous pouvez l'imaginer : l'accès à des fonctions dotées d'attributs sensibles ouvre un large éventail de possibilités d'abus. Sélectionner des personnes sur la base de ces paramètres risque de les soumettre à des préjugés, à des discriminations ou à des refus de services injustes.

À mesure que l’IA devient plus puissante et avant qu’elle ne devienne sensible (quoi qu’on en dise), ce n'est pas encore le cas) besoin d'attention. Il est temps que les grandes entreprises prennent des mesures pour s'assurer que la vie privée et les informations des consommateurs ne sont pas compromises et que cette technologie n'est pas utilisée à des fins malveillantes.