Hier, OpenAI a rencontré le garant italien pour la protection des données personnelles, pour répondre aux problèmes de confidentialité qui ont conduit au blocage temporaire de ChatGPT en Italie. Le chatbot d'intelligence artificielle a été bloqué par la même société américaine, par mesure de précaution, après que les messages et les informations de paiement de certains utilisateurs ont été exposés à d'autres lors d'une violation de données (désastreuse) le 20 mars.

C’est la première fois qu’une démocratie impose un blocus à une plateforme d’IA de cette ampleur. Une opération en soi non sans controverse et ombres. Quoi qu'il en soit, OpenAI a promis de proposer des mesures pour répondre aux préoccupations, bien qu'elles n'aient pas encore été entièrement détaillées. La nouvelle tombe tout droit dans une note sur le même site officiel de l'autorité italienne.

Parlons

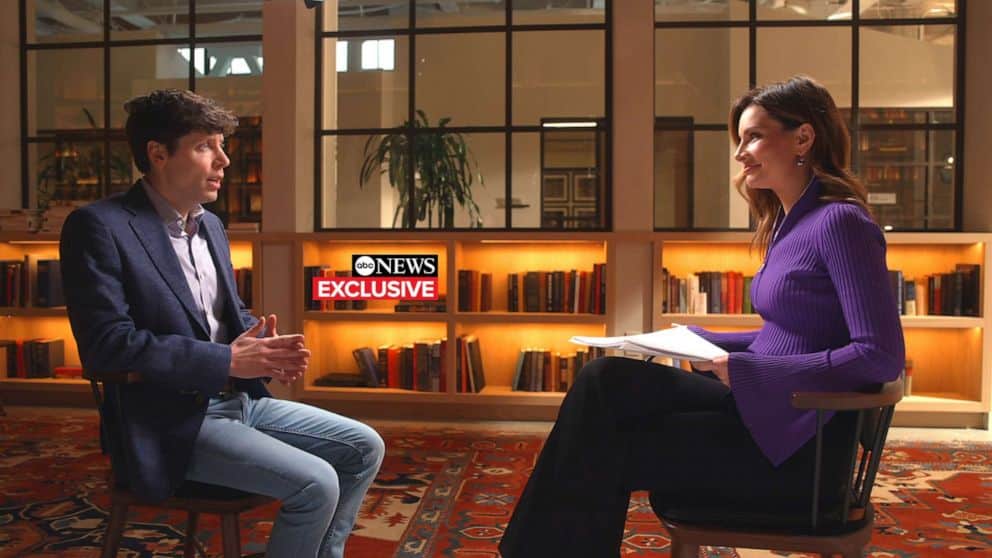

Lors de l'appel vidéo d'hier entre les commissaires du Garant et les responsables d'OpenAI, dont le PDG Sam Altman, on assiste au premier véritable éclair dans toute cette affaire qui tient (je ne plaisante pas) en haleine les entreprises et les particuliers (et la souris sur les VPN, dont les immatriculations ont grimpé en flèche). Pour sa part, la société Altman a promis de présenter des mesures pour répondre à ces préoccupations. Le Garant a toutefois souligné l'importance du respect des réglementations rigoureuses en matière de confidentialité des 27 pays de l'UE. Il a notamment remis en question le fondement juridique de la collecte d'énormes quantités de données utilisées pour entraîner les algorithmes. ChatGPT et a soulevé des inquiétudes quant au fait que le système pourrait générer de fausses informations sur des individus.

La compensation du Garant

Mais le véritable point de toute cette affaire, probablement le résultat de la forte fibrillation de divers secteurs (et de nombreux utilisateurs), a été la main tendue par le Garant. Les commissaires ont exprimé très clairement leur volonté de ne pas entraver le développement de l'IA en Italie. Et cela ne peut qu’empêcher une issue « heureuse » de toute cette affaire.

Que se passe-t-il maintenant?

OpenAI a déclaré qu'il s'efforçait de supprimer les informations personnelles des données de formation dans la mesure du possible, de définir ses modèles pour rejeter les demandes d'informations personnelles émanant de particuliers et de donner suite aux demandes de suppression d'informations personnelles de ses systèmes. Affaire close, alors ? Non. En Italie, comme nous l’avons mentionné, l’impression est qu’il y aura une réouverture du système. Mais plus généralement, les autorités « font chauffer les moteurs » pour combler l'écart et tenter de réguler le secteur.

D’autres régulateurs en Europe et ailleurs ont commencé à y prêter davantage attention après l’action de l’Italie. La Commission irlandaise de protection des données a déclaré qu'elle était « en contact avec l'autorité de contrôle italienne pour comprendre le fondement de leurs actions et se coordonner avec toutes les autorités de protection des données de l'UE sur cette question ». L'organisme français de contrôle de la confidentialité des données, la CNIL, dit qu'elle a lancé une enquête après avoir reçu deux plaintes concernant ChatGPT. Également le commissaire à la protection de la vie privée du Canada ouvert une enquête sur OpenAI. Et il l'a fait après avoir reçu une plainte concernant la prétendue « collecte, utilisation et divulgation de renseignements personnels sans consentement ».

D’un autre côté, le voyage de l’IA ne fait que commencer, n’est-ce pas ?