Selon les recherches, les semaines suivant la sortie d'un hôpital psychiatrique sont une période notoirement difficile pour les personnes fragiles, avec des taux de suicide beaucoup plus élevés que la moyenne.

Désormais, les progrès de l'intelligence artificielle pourraient changer les règles du jeu, aidant les psychiatres à prévoir les tentatives de suicide et à intervenir à temps.

IA et santé mentale

L’apprentissage automatique, qui utilise des algorithmes informatiques pour mieux prédire le comportement humain, est un domaine en pleine croissance dans le domaine de la santé mentale. Une croissance qui va de pair avec celle de biocapteurs capable de surveiller l'humeur d'une personne en temps réel en prenant en compte les choix musicaux, les expressions faciales, le ton de la voix et même les publications écrites sur les réseaux sociaux.

Matthieu K. Nock, psychologue de Harvard et un chercheur attentif au phénomène des suicides espère combiner ces technologies dans une sorte de système d'alerte précoce à utiliser lorsqu'un patient à risque sort d'une hospitalisation psychiatrique.

Comment le système de suicide pourrait fonctionner

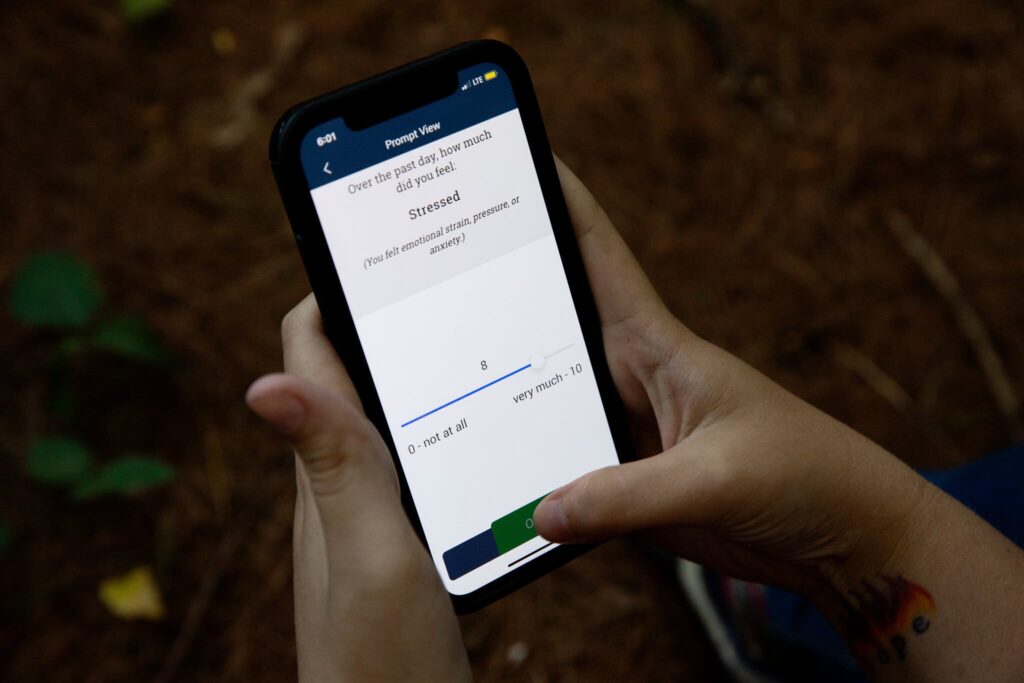

Un capteur signale que le sommeil d'un patient est perturbé, le GPS indique qu'il ne quitte pas la maison. L'accéléromètre de son téléphone montre qu'il bouge beaucoup, suggérant une agitation. Le patient rapporte une humeur maussade sur les questionnaires habituels.

À ce stade, l’algorithme signale le patient. Et un médecin entre en contact avec lui par le biais d'un appel téléphonique ou d'un message.

Cela peut-il fonctionner? Ce n'est pas facile à prévoir. Il y a plusieurs raisons de douter qu'un algorithme atteigne un jour ce niveau de précision. Même parmi les personnes les plus à risque, le suicide est un événement si rare que toute tentative de prédiction peut conduire à des faux positifs, avec des interventions sur des individus qui n'en ont pas besoin. Et tout faux négatif, d'autre part, aurait un poids éthique sur les responsabilités légales d'avoir omis une intervention.

Prévention du suicide, il faut du courage

Des données granulaires à long terme provenant d'un grand nombre de personnes sont nécessaires pour perfectionner l'intelligence artificielle, et elles sont difficiles à obtenir, car heureusement, le suicide, aussi terrible soit-il, est un événement rare. Sans parler du fait que les données nécessaires à la surveillance soulèvent d'énormes problèmes de vie privée, qui plus est sur la vie de personnes déjà vulnérables.

Pourtant, Nock n'abandonne pas. Il faut faire quelque chose et il faut du courage. « Avec tout le respect que je dois à ceux qui font ce travail depuis des décennies, en un siècle nous n’avons rien appris sur la manière d’identifier les personnes à risque de suicide et sur la manière d’intervenir », dit-il.

Le taux de suicide aujourd'hui est le même qu'il y a 100 ans. Donc, il faut le dire honnêtement, nous ne nous améliorons pas.

Matthieu K. Nock

Une tâche difficile

Il n’y a rien de plus énervant pour un psychiatre que de soigner des patients à risque de suicide alors qu’ils sont sans surveillance et à domicile. Il s’agit d’une « zone grise » très compliquée. Avec l’expérience, il devient de plus en plus clair que les pensées suicidaires peuvent aller et venir sans avertissement.

C'est pourquoi de plus en plus de systèmes de santé avancés se tournent vers l'apprentissage automatique pour progresser. Des algorithmes basés sur de vastes ensembles de données provenant des dossiers de santé électroniques et de nombreux autres facteurs sont utilisés pour attribuer aux patients un score de risque, en accordant davantage d'attention aux personnes présentant un risque exceptionnellement élevé.

De plus, il semble que les algorithmes se soient révélés plus précis que les méthodes "traditionnelles", toujours les mêmes depuis 50 ans, selon un recherche 2017. Dès 2017, le Ministère des Anciens Combattants aux États-Unis, il a utilisé un algorithme pour signalent que 0,1 % des anciens combattants sont les plus à risque de suicide.

On parle de quelques milliers de patients sur une population de six millions.

Résultat? Les patients inscrits à ce programme ils étaient 5 % moins susceptibles de tenter de se suicider. Une goutte d'eau dans l'océan, qui ne change pas les tarifs globaux. L'impression est que nous avons commencé à faire des choses qui n'avaient jamais été faites auparavant, mais nous n'avons pas encore trouvé ce que nous recherchons.

A la recherche d'un motif

"Ce n'est pas facile de les repérer", dit-il Nick Allen, directeur du Center for Digital Mental Health de l'Université de l'Oregon. Allen a aidé à développer OREILLES, une application qui suit l'humeur en fonction de facteurs tels que le choix musical, l'expression faciale et le ton verbal.

Un tournant pourrait venir de là. Et revenons au Dr Nock.

En août dernier, un data scientist appelé Adam Ours il s'est assis devant un moniteur dans le laboratoire du Dr Nock et a regardé des graphiques en zigzag des niveaux de stress d'un patient au cours de cette semaine. Il cherchait un schéma : quelque chose qui se répète, et qui peut permettre d'identifier à l'avance quelqu'un qui tentera de se suicider.

Pour cela, Bear a passé tout l'été à examiner les données de 571 patients qui, après avoir pensé ou tenté de se suicider, ont accepté d'être suivis. Au cours du programme de six mois, deux d'entre eux se sont suicidés et 100 ont essayé de le faire.

En résumé : il s'agit du plus grand réservoir d'informations jamais recueillies sur le quotidien des personnes aux prises avec des pensées suicidaires.

Quels sont les signes d'un possible suicide

L'équipe de Nock est très intéressée par les jours qui ont précédé les tentatives de suicide, car c'est le moment où des mesures pourraient être prises. Certains signes sont déjà apparus : bien que les impulsions suicidaires ne changent souvent pas au cours de la période précédant une tentative, la capacité de résister à ces impulsions semble diminuer. Avec un indice récurrent, la privation de sommeil, qui semble beaucoup y contribuer.

Un signal petit mais très important qui nous incite peut-être à insister. Nous n'avons jamais été en mesure d'observer des personnes ayant des pensées suicidaires, car c'est différent d'observer, d'une part, des personnes souffrant de maladies cardiaques.

"La psychologie", dit Nock, "n'a pas progressé aussi loin que les autres sciences parce qu'elle n'avait pas beaucoup d'outils à sa disposition."

Cependant, avec l’avènement des smartphones et des biocapteurs portables, nous avons la possibilité de collecter autant de données pour compenser cet inconvénient.

Un ange sans visage

L'un des dilemmes rencontrés par les chercheurs dans l'étude en cours était de savoir quoi faire lorsque les participants montraient un fort désir de se faire du mal. Le Dr Nock a décidé d'intervenir, même si cela a ralenti la recherche (et pour certains patients, cela l'a contrecarrée).

« Il y a un inconvénient à cela, explique le scientifique, car paradoxalement, cela entraîne moins de suicides et donc moins de chances de trouver un signal. Et si ce patient était mon fils ?

En conséquence, l'étude est également devenue un groupe de travail anti-suicide, et les interventions sont devenues une partie courante de la vie au laboratoire. Si un patient rencontrait un moment critique lors de la surveillance, il recevait un appel téléphonique dans les 15 minutes de l'un des enquêteurs.

"Nous sommes en quelque sorte une personne sans visage, donc il y a moins d'inconfort", dit-il. Narise Ramlal, assistant de recherche au laboratoire. Mais le Dr Nock cherche à comprendre si les interventions numériques pourraient s’avérer plus efficaces.

"Beaucoup de gens ne veulent pas qu'un être humain les contacte lorsqu'ils courent un risque élevé", a-t-il déclaré. "Je ne veux pas dire que nous allons remplacer les humains par des machines, mais parfois elles peuvent être beaucoup plus efficaces que nous ne le sommes actuellement."

Une histoire emblématique

En mars, l'homme de 39 ans Katelin Cruz il est sorti de sa dernière hospitalisation psychiatrique avec beaucoup de détermination, mais aussi de fragilité et de peur. Pour cela il a décidé de participer au monitoring. Elle étudiait pour obtenir un diplôme d'infirmière lorsqu'une série de crises mentales a bouleversé sa vie.

Il était environ 21 heures, quelques semaines après le début de l'étude de six mois, lorsqu'une question est apparue sur son téléphone : « En ce moment, quelle est la force de votre désir de vous suicider ?

Sans s'arrêter pour réfléchir, Katelin toucha l'écran : 10. Quelques secondes plus tard, on lui demanda de choisir entre deux affirmations : "Aujourd'hui je ne me tuerai certainement pas" et "Aujourd'hui je vais certainement me tuer". Il a choisi la deuxième phrase.

Quinze minutes plus tard, son téléphone sonna. Elle faisait partie du groupe de recherche qui l'appelait, avait déjà alerté la police et gardé Katelin en ligne jusqu'à ce que la police frappe à sa porte : peu de temps après, Katelin a fait une dépression émotionnelle et s'est évanouie.

Qu'elle résolve ou non le problème, la technologie du suicide peut déjà faire quelque chose : être là.

Katalin a commencé à répondre rapidement aux six « invites » qu'elle recevait chaque jour lorsque l'application sur son téléphone l'interrogeait sur ses pensées suicidaires. Des notifications ? Intrusif au début, puis réconfortant.

«Je ne me sentais plus ignorée», dit-elle. "Avoir quelqu'un qui sait ce que je ressens m'enlève un peu de poids." Il pense que la technologie (sa « neutralité », son « manque de jugement ») facilite la demande d'aide. « Je pense qu'il est presque plus facile de dire la vérité à un ordinateur », a-t-il déclaré.

De nombreux experts pensent que cela pourrait être l'inverse : les patients en crise sont habiles à tromper les opérateurs sur leur état de santé, et avec un ordinateur, il est également plus facile de mentir. Des gens bien meilleurs : un groupe de soutien qui se réunit chaque semaine, un cercle de chaises, un réseau d'amis, de famille et de médecins.

Tout le monde ne l'a pas. En Italie, la liste d'attente pour un thérapeute dans un centre public de santé mentale peut aller jusqu'à trois mois. Aux États-Unis, c'est huit mois.

Et dis-moi que tu ne veux pas mourir

La semaine dernière, à la fin de l'essai clinique de six mois, Katalina a rempli son dernier questionnaire avec une certaine tristesse. La sensation que quelqu'un la regarde, même s'il s'agit d'une personne sans visage, à distance, à travers un appareil, lui manquera.

Il y a des moments, très rares, où un "Big Brother" peut vous faire vous sentir mieux. Auriez-vous jamais dit cela ?

"Honnêtement, je me sentais un peu plus en sécurité de savoir que quelqu'un se souciait suffisamment de lire ces données tous les jours", explique Katalina.

Et je la crois.

Si vous envisagez de vous suicider, appelez le 112 ou parler au numéro de téléphone : tous les jours de 10h à 24h, au numéro +02 (23272327)XNUMX XNUMX ou avec un appel web gratuit sur www.telefonoamico.net