L’année 2029 restera peut-être dans les mémoires comme le moment où l’humanité a rencontré son double numérique : l’intelligence artificielle générale (IAG). Avec les progrès de technologies comme GPT-4, nous approchons d’un point où l’IA pourrait égaler, voire dépasser les capacités cognitives humaines. Un scénario qui soulève une question fondamentale : comment nos vies vont-elles changer ?

Intelligence artificielle générale et singularité technologique : nous parlons d’un changement d’époque

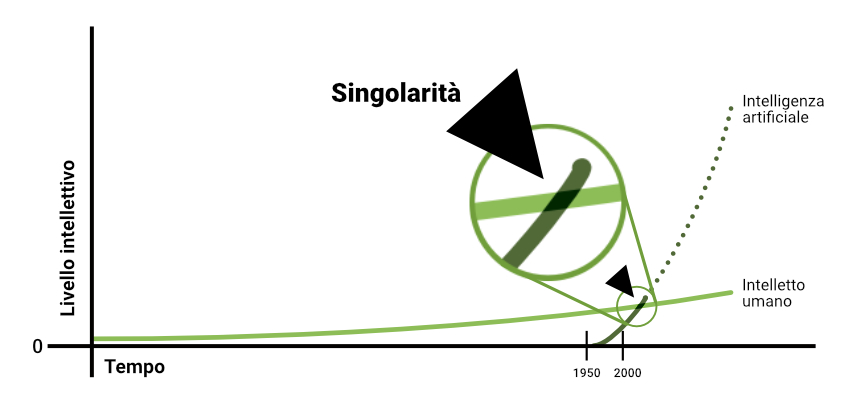

Je vais faire simple : intelligence générale artificielle (AGI) c'est un type d'intelligence artificielle qui peut apprendre, comprendre et appliquer ses connaissances dans un large éventail de tâches, tout comme le fait un humain. Fondamentalement, c'est comme avoir un ordinateur ou un robot capable de réfléchir et de résoudre des problèmes dans de nombreux domaines différents, et non dans un seul domaine spécifique. La singularité technologique c’est un concept qui évoque les images d’un avenir dans lequel l’intelligence artificielle générale non seulement assiste l’humanité, mais la surpasse d’une manière que nous ne pouvons qu’imaginer aujourd’hui. Cet événement représente un tournant possible dans l’histoire de l’humanité. La Singularité n’est pas seulement une réussite technologique, mais aussi un moment de réflexion profonde sur notre rôle dans un monde en évolution rapide.

GPT-4 et l'approche de l'AGI

GPT4, la dernière itération des modèles de langage génératifs d'OpenAI, a marqué une étape significative vers l'AGI. Cette technologie, qui montre déjà des capacités étonnamment avancées de compréhension et de génération du langage, n’est que la pointe de l’iceberg. Son arrivée a accéléré le chemin vers un moment qui, selon les prévisions et attentes précédentes, se situerait plus tard dans les années. remettre en question les prédictions et les attentes antérieures. Historiquement, les chercheurs en IA ont prédit que la singularité se produirait en moyenne vers 2050. Les experts en études futures, qui révisent périodiquement leurs estimations, sont répartis dans cette fourchette :

Vernor Vinge, qui a inventé le terme « singularité technologique » et affiné ses concepts dans les années 80 et 90, a prédit ce tournant d’ici 2050, au milieu de ce siècle. Ben Goertzel, un autre chercheur de premier plan dans le domaine de l’IA, a prédit entre 2000 et 2010 l’intelligence artificielle générale (et la singularité technologique) d’ici la fin des années 30 de ce siècle. ray Kurzweil, en 2005, prédisait l’arrivée du « grand changement » d’ici 2029. Il a d’ailleurs écrit un livre à ce sujet, « La singularité est proche ».

Et puis il y a Paul Pallaghy

l'ingénieur IA (et futurologue) Paul Pallaghy de l'Université de Melbourne a peut-être détaillé plus que quiconque les prédictions sur l'avènement de ce moment clé de l'histoire de notre espèce. En 2012, il dressait une sorte de petite feuille de route qui devait nous rapprocher de l’intelligence artificielle générale, avec toutes les conséquences de l’affaire. Il est parti d’une intuition, qui s’est ensuite révélée exacte : les ordinateurs quantiques ne seraient pas nécessaires pour développer des modèles de traitement du langage naturel (NLU), comme le prédisaient plusieurs collègues. Nous aurions pu le faire avec les capacités informatiques de l’informatique « traditionnelle ». C’était une prédiction que, avec le recul, nous pouvons juger comme faisant autorité : Pallaghy travaillait à l’époque sur ces mêmes modèles.

Pour être concis, voici ses prédictions en 2012 :

- Compréhension adéquate du langage naturel (NLU) d’ici 2020.

- Compréhension du langage naturel (NLU) de type humain d’ici 2022.

- Intelligence Générale Artificielle (AGI) d’ici 2024.

- Androïdes par 2026.

- La singularité de l’intelligence artificielle pourrait intervenir dès 2025, mais presque certainement d’ici 2029.

Il les a réitérés à plusieurs reprises, jusqu'en 2021 où il les a condensés dans un article sur son blog. De nombreux collègues ne s'en souvenaient pas bien, pour la simple raison qu'en 2012, ils pensaient probablement qu'ils étaient fous. La réalité d’aujourd’hui est cependant étonnamment similaire aux deux premiers points. Ils sont juste déphasés d’un an. NLU naturel ? 2021. NLU « humanoïde » (GPT-4) ? 2023. Et maintenant?

Les estimations révisées de Pallaghy

- 2023 : Humanoïde NLU (réalisé avec GPT-4).

- 2024 : NLU mature et AGI désincarné avancé.

- 2025 : Des milliers d'androïdes disponibles pour moins de 100.000 XNUMX €.

- 2026 : Le premier potentiel d’une singularité d’IA superintelligente désincarnée.

- 2027 : Des millions d'androïdes disponibles pour moins de 50.000 XNUMX €.

- 2028 : le premier potentiel d'une singularité IA basée sur Android.

- 2029 : Des dizaines de millions d’androïdes quasi-superintelligents disponibles pour environ 25.000 XNUMX €.

En résumé, sa prédiction centrale est une singularité en 2028, qui pourrait cependant se produire dès 2026. Il est essentiel de comprendre une chose si l’on veut saisir le sens des prédictions de Pallaghy. Quelque chose que beaucoup ne comprennent pas et qui mine leur capacité à évaluer le timing de ces phénomènes. L’intelligence artificielle générale qui pourrait déclencher la Singularité, c’est-à-dire l’hypothétique accélération autonome de l’évolution de l’IA, ne nécessite pas de conscience de soi. Il n’est pas nécessaire d’être « conscient » pour agir. Il n’est pas nécessaire que ce soit une « vie artificielle ». Il doit juste être un peu plus avancé que GPT-4 (ou peut-être la prochaine itération, GPT-5), avec plus de mémoire à long terme et à court terme et un peu plus d'entraînement pour atteindre les objectifs appropriés.

Intelligence artificielle générale : quelles conséquences ?

À mesure que nous nous dirigeons vers l’AGI, des questions éthiques et sociales cruciales émergent. Comment allons-nous gérer une intelligence qui surpassera la nôtre à bien des égards ? Quelles mesures de sécurité et directives éthiques devrions-nous mettre en œuvre pour garantir que son essor soit bénéfique à l’humanité ? Ce ne sont pas de simples questions théoriques : elles nécessitent des réponses concrètes et des actions immédiates.

Il est essentiel que nous nous préparions adéquatement. Cela signifie non seulement faire progresser la technologie, mais aussi réfléchir aux implications plus larges de l'AGI, sur les implications positives que diriez-vous les négatifs. Nous devons réfléchir à la manière dont l’AGI affectera le travail, l’éducation, l’éthique et la société dans son ensemble. C'est une tâche qui nécessite la collaboration de scientifiques, philosophes, législateurs, sociologues (surtout eux !) et les citoyens.

Un avenir incertain, prometteur et dangereux

Le chemin vers la singularité technologique est plein d’incertitudes, mais aussi d’immenses possibilités. L’intelligence artificielle générale pourrait représenter une menace existentielle ou une opportunité sans précédent pour l’humanité. La clé est d’affronter ces scénarios avec sagesse, prudence et en gardant toujours un œil sur les implications plus larges de nos choix technologiques. Nous pourrions nous rapprocher de 2026 et, en 2029, nous pourrions avoir un avenir exorbitant.

Les commentaires sont fermés.