Nvidia, le géant des GPU qui a conquis le monde de l'intelligence artificielle, ne montre aucun signe de ralentissement. Au contraire, avec la présentation de la nouvelle GPU Blackwell B200 et la « superpuce » GB200 semble vouloir accroître encore son avance sur la concurrence.

Ces monstres de puissance de calcul, avec des performances jusqu'à 30 fois supérieures à celles du déjà impressionnant H100, promettent de redéfinir les horizons de l'IA et de consolider la domination de Nvidia dans un secteur de plus en plus stratégique et compétitif.

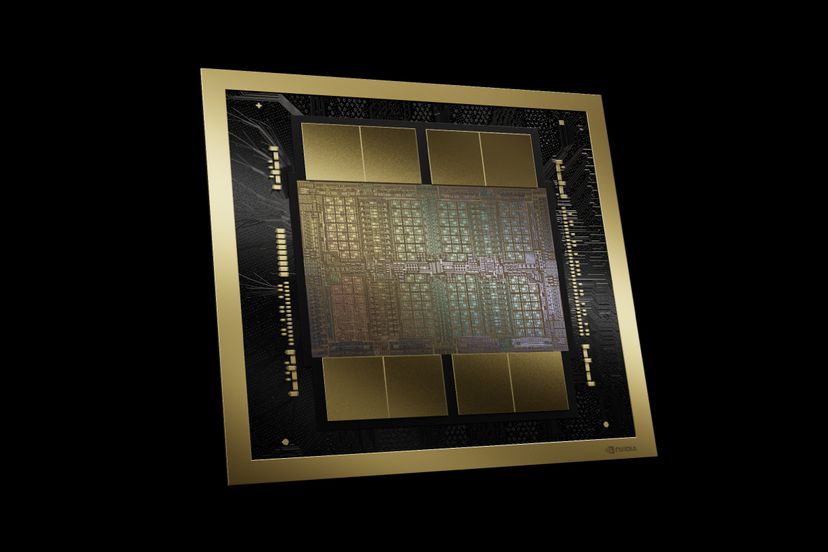

Blackwell B200, 208 milliards de transistors et 20 pétaflops de puissance pure

Les chiffres donnent le vertige. Le nouveau GPU B200 regroupe 208 milliards de transistors (oui, vous avez bien lu, des milliards) dans une seule puce, libérant jusqu'à 20 pétaflops de puissance de calcul à virgule flottante 4 bits (FP4). Pour vous donner une idée, c'est une puissance comparable à celle de 20 millions d'ordinateurs portables haut de gamme. Et tout cela dans une seule puce de la taille d’une carte postale.

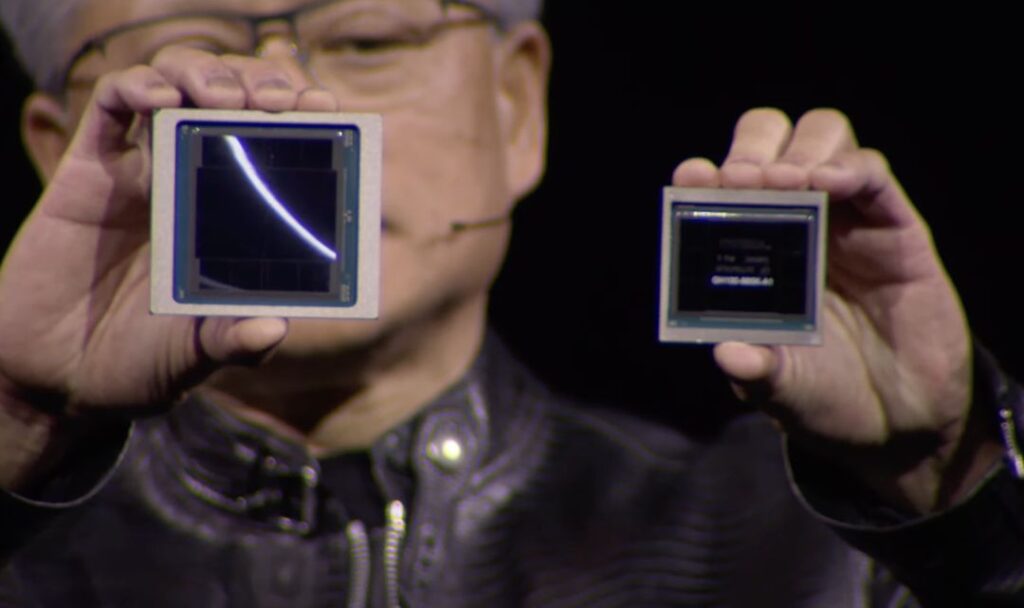

Mais le véritable atout de Nvidia est Blackwell GB200, une « superpuce » qui fusionne deux GPU B200 avec un processeur Grace dans un seul boîtier. Cette bête de 30 pétaflops promet d'offrir jusqu'à 30 fois les performances du H100 sur les tâches d'inférence de grands modèles de langage (LLM), avec une réduction de 25 % du coût et de la consommation d'énergie. En deux mots : plus de puissance, moins de dépenses, moins d’impact environnemental. Oui, il y avait 7 mots.

Lorsqu'une puce ne suffit pas, le « moteur du transformateur » s'en charge

Comment Nvidia fait-il ressortir toute cette puissance ? L'un des secrets réside dans le « moteur transformateur » de deuxième génération : une architecture dédiée qui double la capacité de calcul, en plaçant plus de neurones dans moins d'espace, pour des réseaux neuronaux de plus en plus grands et performants.

Que se passe-t-il lorsque vous rassemblez des dizaines ou des centaines de ces puces sur un serveur ? Jusqu'à 576 GPU peuvent « communiquer » entre eux avec une bande passante bidirectionnelle de 1,8 téraoctets par seconde. En trois mots (pour de vrai cette fois, je le jure) : calcul parallèle extrême.

Des puces aux supercalculateurs, il n’y a qu’un pas

Si vous voulez une idée de ce que nous allons voir bientôt, les systèmes qui seront pilotés par ces Blackwell seront capables d'entraîner des modèles avec 27 4 milliards de paramètres. GPT-1,7 n’en compte « que » XNUMX XNUMX milliards.

Nvidia semble lancer un défi à l’ensemble du monde de l’IA : voulez-vous aller vite ? Suivez-nous. Et les grands acteurs du cloud semblent avoir compris le message : Amazon, Google, Microsoft et Oracle se sont déjà alignés pour proposer ces babioles dans leurs services. Un signe que la soif de puissance de calcul est plus forte que jamais.

Avec Blackwell, Nvidia est-il en train de tuer le marché ?

Il y a ceux qui se moquent de cette puissance excessive de Nvidia, qui risque de créer un monopole de fait dans un secteur clé comme l'intelligence artificielle. C'est bien de poser la question. Certains craignent que cette course au « plus grand, plus rapide, plus puissant » puisse conduire à un développement incontrôlé de systèmes d’IA de plus en plus complexes et imprévisibles. C'est aussi une question légitime.

Car au-delà de ces points d'interrogation, avec Blackwell et GB200 Nvidia a démontré qu'il avait le pied appuyé sur l'accélérateur de l'innovation. Mauvais. Et que je n'ai pas l'intention de le supprimer.

Qu'on le veuille ou non, l'avenir de l'IA parle de plus en plus le langage des GPU. Et il a le visage sournois de Jensen Huang.