Avec une diffusion en direct sur YouTube à 21 heures, heure italienne, OpenAI a présenté son nouveau joyau, GPT-4, qui se situe à un niveau nettement supérieur à la version précédente, lancée il y a seulement quelques mois. Désormais, ChatGPT, « l’expert en conversation », est non seulement plus puissant, mais il peut aussi « voir ». Et ce facteur peut donner lieu à une accélération sans précédent du développement de l’intelligence artificielle.

De GPT-3 à GPT-4 une mer passe

ChatGPT, le « petit génie électronique » d'OpenAI qui répond aux messages avec du texte et du code, est rapidement devenue l'application à la croissance la plus rapide de l'histoire, avec plus de 100 millions d'utilisateurs par mois.

Parallèlement à son développement, des communautés d'utilisateurs et des guides d'utilisation sont nés (j'en ai également publié un : si cela vous intéresse vous pouvez le trouver sur Amazon) et même un « proto-métier », celui de ingénieur rapide.

Cependant, malgré son succès, ChatGPT avait quelques problèmes à résoudre. Il avait tendance à « halluciner », générant des textes qui semblaient plausibles mais qui ne l'étaient pas. Il reflétait des préjugés, parfois il « perçait » les filtres de phrases illicites prévus par ses créateurs.

La nouvelle version basée sur GPT-4 résout la plupart de ces problèmes et améliore (beaucoup) les performances.

Les yeux ouverts sur le monde

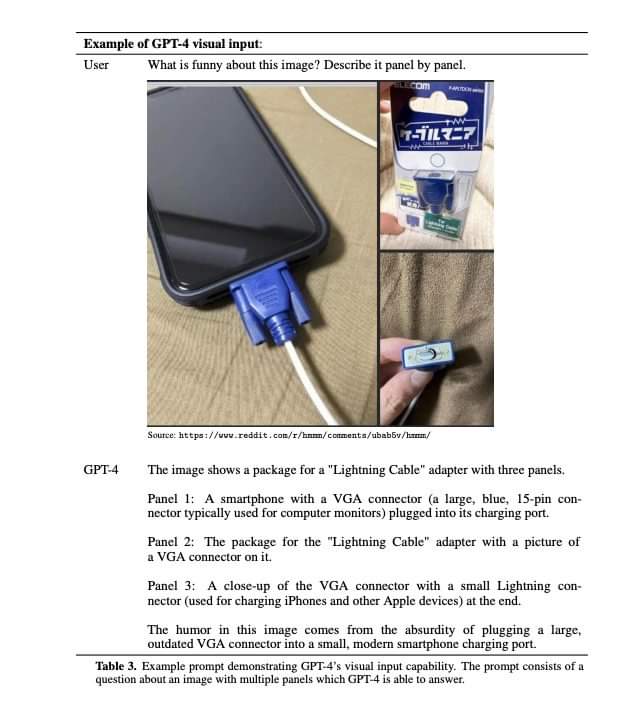

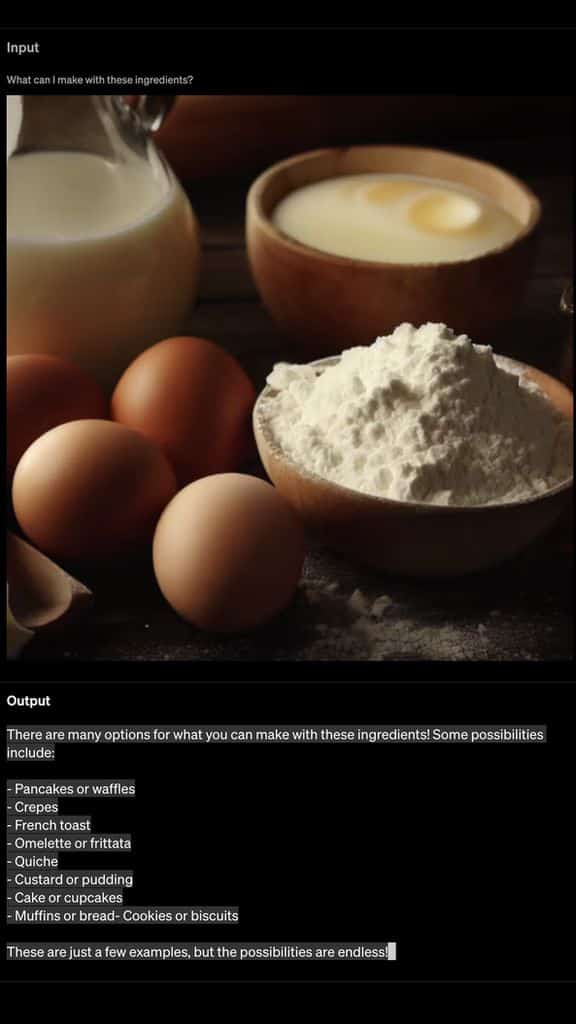

La grande nouveauté de ce modèle est sa capacité à répondre à des invites textuelles et visuelles. Pensez aux possibilités : identifier l'auteur d'un tableau, expliquer la signification d'un mème, créer des légendes pour des photographies... La vérité est que le champ des applications possibles s'élargit tellement qu'une liste possible devient gigantesque.

Mais GPT-4 ne s'arrête pas là : il est également nettement plus « intelligent » que son prédécesseur, surpassant ses résultats à plusieurs tests, comme ceux destinés aux professions juridiques. (LSAT), ceux utilisés pour l'admission dans les collèges américains (SAM), et plein d'autres. OpenAI affirme que GPT-4 c'est 40% plus précis dans la génération de contenu véridique e 82% moins enclin pour répondre aux invites illicites (adieu les versions « maléfiques » du chatbot).

Tout le reste appartient à l'histoire

On s’interrogera beaucoup sur les caractéristiques incroyables que les intelligences artificielles génératives vont acquérir de plus en plus (et de plus en plus rapidement). Grâce à sa capacité à « voir », GPT-4 alimentera de nombreuses applications que nous utilisons au quotidien.

Tout d'abord, comme mentionné, le nouveau ChatGPT (dans sa version payante), désormais capable de traiter des textes jusqu'à 25.000 4 mots : il peut résumer, écrire et réécrire, gérer des livres entiers. GPT-XNUMX fait également partie du moteur de recherche Bing. Khan Academy l'utilise pour créer un tuteur virtuel pour les étudiants, tandis que Sois mes yeux a développé un assistant IA capable d'analyser et de décrire des photographies pour les personnes ayant une déficience visuelle.

Suivre ses évolutions sera de plus en plus compliqué.

GPT-4, perspectives d'avenir

Bien évidemment le système peut encore être amélioré, il présente encore des imperfections, mais les progrès sont notables et très rapides. La société étudie déjà comment intégrer également des entrées audio, vidéo et autres dans les futures versions du modèle. Leur objectif est que GPT-4 devienne un outil précieux pour améliorer la vie des gens en alimentant de nombreuses applications.

Bientôt, cet appareil nous dira également ce qu'il pense de nos vêtements ou nous recommandera la coupe de cheveux la plus adaptée. Cela alimentera les systèmes de surveillance auxquels nous présentons nos amis et nos proches, afin qu'ils ne s'ouvrent immédiatement qu'à eux seuls. Cela fera de nos voitures des « supercars » qui interagiront de manière personnelle avec le conducteur. Ce sera la « voix narrative » de nombreux aveugles et les aidera à se sentir plus intégrés. Et qui sait quoi d'autre.

Comme mentionné, je ne peux pas vous montrer tous les points d'arrivée : tout au plus vous renvoyer au point de départ avec l'annonce officielle. sur le blog OpenAIou avec la vidéo de la présentation d'hier, afin que vous puissiez vous faire une idée par vous-même.

Mais pour l’instant, disons « bienvenue » à cet extraordinaire touche-à-tout qui, pour ceux qui ne l’auraient pas encore compris, a déjà changé nos vies.